El funcionario describió esto como un ejemplo de cómo podrían funcionar las cosas, pero no confirmó ni negó si representa cómo se utilizan actualmente los sistemas de inteligencia artificial.

Otros medios han informado que Claude de Anthropic se ha integrado en sistemas militares de IA existentes y se ha utilizado en operaciones en Irán y Venezuelapero los comentarios del funcionario aportan información sobre el papel específico que pueden desempeñar los chatbots, particularmente a la hora de acelerar la búsqueda de objetivos. También arrojan luz sobre la forma en que el ejército está desplegando dos tecnologías de IA diferentes, cada una con distintas limitaciones.

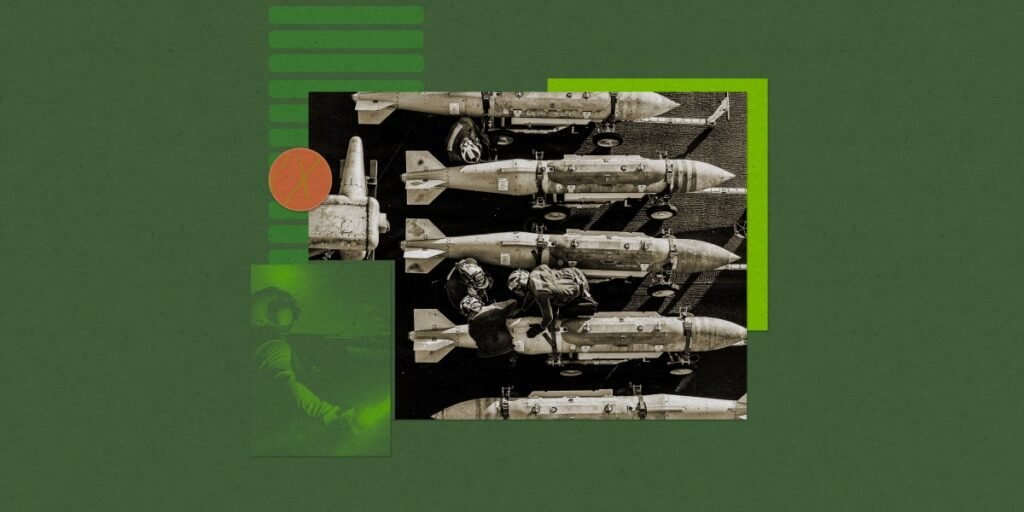

Al menos desde 2017, el ejército estadounidense ha estado trabajando en una iniciativa de “grandes datos” llamada Maven. Utiliza tipos más antiguos de IA, en particular visión por computadora, para analizar los océanos de datos e imágenes recopilados por el Pentágono. Maven podría tomar miles de horas de imágenes aéreas de drones, por ejemplo, e identificar objetivos algorítmicamente. Un 2024 informe de la Universidad de Georgetown mostró a soldados usando el sistema para seleccionar objetivos y examinarlos, lo que aceleró el proceso para obtener la aprobación de estos objetivos. Los soldados interactuaban con Maven a través de una interfaz con un mapa del campo de batalla y un panel de control, que podía resaltar objetivos potenciales en un color y fuerzas amigas en otro.

Los comentarios del funcionario sugieren que la IA generativa ahora se está agregando como una capa de chatbot conversacional, una que el ejército puede usar para encontrar y analizar datos más rápidamente a medida que toma decisiones como qué objetivos priorizar.

Los sistemas de IA generativa, como los que sustentan ChatGPT, Claude y Grok, son una tecnología fundamentalmente diferente de la IA que ha impulsado principalmente a Maven. Construidos sobre grandes modelos de lenguaje, están mucho menos probados en batalla. Y aunque la interfaz de Maven obligaba a los usuarios a inspeccionar e interpretar directamente los datos en el mapa, los resultados producidos por los modelos generativos de IA son más fáciles de acceder pero más difíciles de verificar.

El uso de IA generativa para tales decisiones está reduciendo el tiempo requerido en el proceso de selección de objetivos, agregó el funcionario, quien no proporcionó detalles cuando se le preguntó cuánta velocidad adicional es posible si se requiere que los humanos dediquen tiempo a verificar los resultados de un modelo.

El uso de sistemas militares de IA está bajo un mayor escrutinio público tras el reciente ataque a una escuela de niñas en Irán en el que murieron más de 100 niños. Múltiple noticias salidas han informado que el ataque fue de un misil estadounidense, aunque el Pentágono ha dicho que todavía está bajo investigación. Y mientras el Correo de Washington tiene reportado Aunque Claude y Maven han estado involucrados en decisiones sobre objetivos en Irán, aún no hay evidencia que explique qué papel desempeñaron los sistemas generativos de IA, si es que tuvieron alguno. El New York Times reportado el miércoles que una investigación preliminar encontró que datos obsoletos sobre objetivos eran en parte responsables de la huelga.