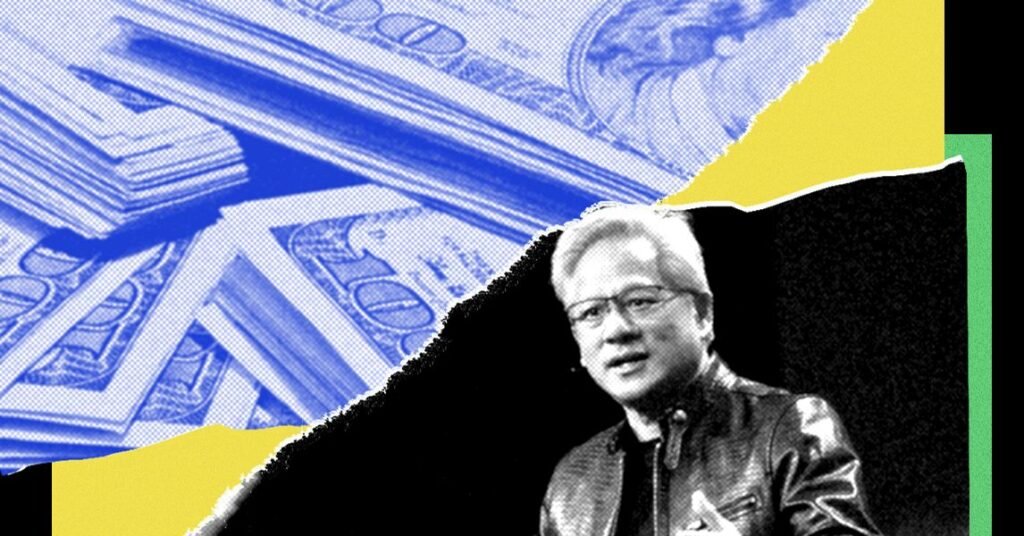

Nvidia gastará 26 mil millones de dólares en los próximos cinco años para construir modelos de inteligencia artificial de código abierto, según un presentación financiera 2025. Los ejecutivos confirmaron la noticia, que no se había informado anteriormente, en entrevistas con WIRED.

La considerable inversión podría hacer que Nvidia evolucione de un fabricante de chips con una impresionante pila de software a un auténtico laboratorio de frontera capaz de competir con OpenAI y DeepSeek. Es un movimiento estratégico que podría consolidar aún más el lugar de Nvidia como el principal fabricante de chips de IA del mundo, ya que los modelos están adaptados al hardware de la empresa.

Los modelos de código abierto son aquellos en los que los pesos o los parámetros que determinan el comportamiento de un modelo se publican públicamente, a veces con los detalles de su arquitectura y entrenamiento. Esto permite que cualquiera pueda descargarlo y ejecutarlo en su propia máquina o en la nube. En el caso de Nvidia, la compañía también revela las innovaciones técnicas involucradas en la construcción y capacitación de sus modelos, lo que facilita que las nuevas empresas y los investigadores modifiquen y desarrollen las innovaciones de la compañía.

El miércoles, Nvidia también lanzó Nemotron 3 Super, su modelo de IA de peso abierto más capaz hasta la fecha. El nuevo modelo tiene 128 mil millones de parámetros (una medida del tamaño y la complejidad del modelo), lo que lo hace aproximadamente equivalente a la versión más grande de GPT-OSS de OpenAI, aunque la compañía afirma que supera a GPT-OSS y otros modelos en varios puntos de referencia.

Específicamente, Nvidia afirma que Nemotron 3 Super recibió una puntuación de 37 en el Índice de Inteligencia Artificial, que califica modelos en 10 puntos de referencia diferentes. GPT-OSS obtuvo una puntuación de 33, pero varios modelos chinos obtuvieron una puntuación más alta. Nvidia dice que Nemotron 3 Super fue probado en secreto en PinchBench, un nuevo punto de referencia que evalúa la capacidad de un modelo para controlar OpenClaw, y ocupa el puesto número uno en esa prueba.

Nvidia también introdujo una serie de trucos técnicos que utilizó para entrenar Nemotron 3. Estos incluir técnicas arquitectónicas y de formación que mejoran las capacidades de razonamiento del modelo, el manejo de contextos prolongados y la capacidad de respuesta al aprendizaje por refuerzo.

«Nvidia se está tomando mucho más en serio el desarrollo de modelos abiertos», afirma Bryan Catanzaro, vicepresidente de investigación de aprendizaje profundo aplicado en Nvidia. «Y estamos logrando muchos avances».

Frontera abierta

Meta fue la primera gran empresa de inteligencia artificial en lanzar un modelo abierto, Llama, en 2023. Sin embargo, el director ejecutivo, Mark Zuckerberg, reinició recientemente los esfuerzos de inteligencia artificial de la empresa y señaló que Es posible que no haga que los modelos futuros sean completamente abiertos. OpenAI ofrece un modelo de peso abierto, llamado GPT-oss, pero es inferior a las mejores ofertas patentadas de la compañía y no se adapta bien a las modificaciones.

Solo se puede acceder a los mejores modelos estadounidenses, de OpenAI, Anthropic y Google, a través de la nube o mediante una interfaz de chat. Por el contrario, los pesos de muchos de los mejores modelos chinos, de DeepSeek, Alibaba, Moonshot AI, Z.ai y MiniMax, se publican de forma abierta y gratuita. Como resultado, muchas empresas emergentes e investigadores de todo el mundo están construyendo sobre modelos chinos.

“Nos interesa ayudar a que el ecosistema se desarrolle”, dice Catanzaro, quien se unió a Nvidia en 2011 y ayudó a liderar el cambio de la compañía de fabricar tarjetas gráficas para juegos a fabricar silicio para IA. Nvidia lanzó el primer modelo Nemotron en noviembre de 2023. Agrega que Nvidia recientemente terminó de entrenar previamente un modelo de 550 mil millones de parámetros. (El preentrenamiento implica introducir enormes cantidades de datos en un modelo distribuido en una gran cantidad de chips especializados que se ejecutan en paralelo). Desde entonces, Nvidia ha lanzado una variedad de modelos especializados para su uso en áreas como robótica, modelado climático y plegamiento de proteínas.

Kari Briski, vicepresidente de software de IA generativa para empresas, afirma que los futuros modelos de IA de Nvidia ayudarán a la empresa a mejorar no sólo sus chips sino también los centros de datos a escala de supercomputadoras que construye. «Lo construimos para ampliar nuestros sistemas y probar no solo la computación sino también el almacenamiento y las redes, y para desarrollar nuestra hoja de ruta de arquitectura de hardware», dice.